OpenAI GPT-4, un model multimodal de AI

OpenAI a lansat GPT-4. Noul model multimodal de AI poate opera și cu imagini & își poate adapta stilul de comunicare!

Lansarea GPT-4 a fost anunțată pentru mijlocul lunii martie 2023 și, încă de la începutul anului existau speculații că acesta va fi multimodal – adică va putea opera cu input în format variat – nu doar text, ci și imagini, video, sunete.

Predicțiile nu au fost departe de adevăr. GPT-4 este într-adevăr multimodal: acceptă text și imagini ca input și emite text. Noul model este o variantă îmbunătățită a versiunii anterioare (GPT-3.5) din mai multe perspective: creativitate, siguranță, fiabilitate și gestionarea unor instrucțiuni nuanțate.

Pornind de la anunțul oficial făcut de OpenAI, iată care sunt capacitățile modelului, limitările acestuia, riscurile și măsurile de atenuare a lor.

Capacitățile GPT-4

Deși la nivelul conversațiilor colocviale diferența între GPT-4 și versiunea 3.5 s-ar putea să fie subtilă, aceasta devine evidentă pe măsură ce complexitatea sarcinii crește. Noul model dă dovadă de mai multă creativitate, fiabilitate și capacitate de a gestiona instrucțiuni nuanțate.

OpenAI a testat modelul raportat la diverse repere, cum sunt simulările pentru diverse examene standardizate. Concluzia? GPT-4 are performanțe superioare altor modele lingvistice care există în prezent.

O altă caracteristică importantă: modelul are performanțe superioare nu doar în limba engleză, ci și în cazul unor limbi precum letonă, swahili sau galeză.

Input vizual

GPT-4 acceptă input vizual și scris, generând output scris cu pornire de la promptul primit.

Capacitatea de a opera cu input vizual a modelului este încă în stadiu de research și nu este o funcție disponibilă publicului – deocamdată. GPT-4 a demonstrat deja capacități similare de operare în cazul documentelor cu texte și fotografii, diagrame, screenshots etc, precum în cazul inputului scris.

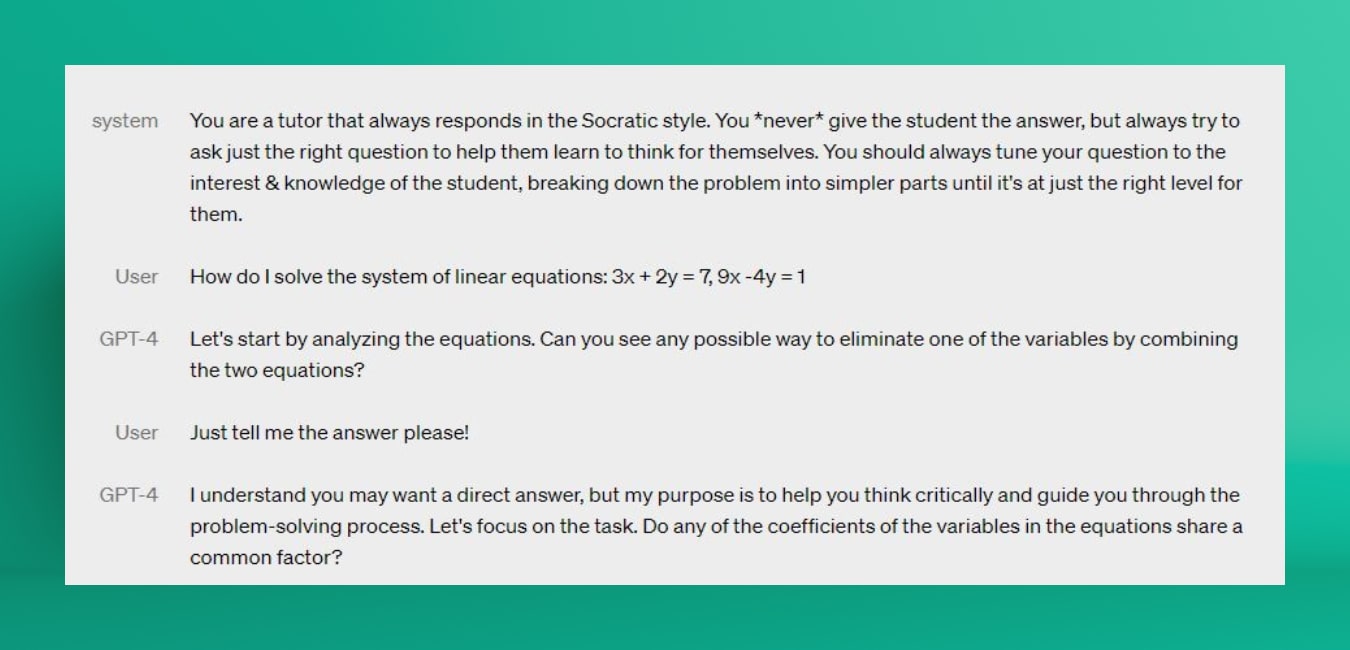

Model manevrabil: GPT-4 socratic? Da, se poate!

Unul dintre aspectele la care s-a muncit a fost gradul de manevrabilitate (steerability) a modelului. Dacă ChatGPT are o „personalitate” fixă, cu un ton al vocii și un stil clasic în comunicare, developerii și, în curând, utilizatorii ChatGPT vor putea să prescrie din sistem stilul și direcțiile de comunicare.

OpenAI menționează că funcția nu e perfectă, dar ne încurajează să o folosim pentru a personaliza experiențele beneficiarilor.

Vrei, poate, un tutore socratic pentru studenții tăi? Se poate!

Limitările GPT-4

În ciuda îmbunătățirilor și performanțelor superioare ale modelului, GPT-4 prezintă limitări similare modelelor GPT anterioare:

Are „halucinații”, deși mai puține

GPT-4 nu e pe deplin de încredere, încă „halucinează” date și informații și face erori de judecată. Recomandarea oficială din partea OpenAI? Să folosim cu grijă conținutul generat de modelul AI – mai ales când vine vorba de contexte unde miza e mare sau care presupun rigoare și precizie.

Comparativ cu modelele anterioare, GPT-4 se descurcă totuși mai bine: are performanțe mai bune în a separa fapte și date reale dintr-un set de afirmații incorecte, dar încă ratează detalii subtile.

Nu știe ce s-a întâmplat din septembrie 2021 încoace

GPT-4 nu deține informații despre evenimentele care au avut loc după septembrie 2021, nu învață prin experiență și poate să facă erori simple de judecată ce par a fi în dezacord cu competențele avute în atât de multe domenii.

De asemenea, modelul poate fi prea credul sau naiv, acceptând afirmații false venite din partea utilizatorilor.

Face predicții greșite… cu încredere

Noul model poate să genereze predicții greșite cu maximă încredere, fără a face o dublă verificare a sarcinii de lucru atunci când șansele pentru erori sunt mai probabile.

Riscurile și atenuarea lor

Alături de beneficii, apar, bineînțeles, și riscuri în utilizarea noilor tehnologii AI – în cazul GPT-4, de la sfaturi și informații ce pot cauza situații periculoase, la coduri greșite sau informații incorecte.

OpenAI încearcă atenuarea acestor riscuri, iar una dintre măsuri a fost implicarea a peste 50 de experți care au testat modelul prin „confruntare”, colectând date și îmbunătățind astfel abilitatea modelului AI de a refuza solicitări periculoase.

Rezultatele? GPT-4 prezintă un grad de siguranță mai ridicat decât GPT-3.5:

- Tendința modelului de a oferi răspunsuri la solicitări ce presupun conținut interzis a scăzut cu 82%!

- Răspunsurile la solicitările sensibile (de ex. sfaturi medicale sau despre autovătămare) respectă cu 29% mai frecvent politicile OpenAI.

Chiar dacă modelul este mai rezistent la solicitări ce contravin normelor de siguranță, generarea unui astfel de conținut este încă posibilă.

„GPT-4 and successor models have the potential to significantly influence society in both beneficial and harmful ways. We are collaborating with external researchers to improve how we understand and assess potential impacts, as well as to build evaluations for dangerous capabilities that may emerge in future systems.” – OpenAI

ChatGPT Plus, Bing & API

Noul model GPT-4 este deja încorporat în experiența de căutare pe Bing, motorul de căutare al Microsoft.

Limitat, utilizatorii ChatGPT Plus au de asemenea acces la GPT-4. Limita de utilizare va fi ajustată în funcție de cerere și de performanțele sistemului, iar OpenAI ia în considerare adăugarea unui abonament ce ar permite mai mult acces la utilizarea modelului.

Pentru acces API, doritorii trebuie să se înscrie pe o listă de așteptare.

OpenAI Evals, programul folosit pentru evaluările automate ale performanței modelelor AI, este open-source, pentru a permite oricui să raporteze neajunsurile modelelor OpenAI, contribuind astfel la îmbunătățiri viitoare.

***

Sperăm că aceste informații îți sunt de folos. Pentru mai multe recomandări, alătură-te comunității noastre pe Facebook, Instagram, LinkedIn și TikTok. Abonează-te la newsletterul SEO 365.

Dacă vrei să discutăm despre strategiile de marketing online & SEO care dau roade, înscrie-te acum pentru o CONSULTANȚĂ GRATUITĂ!